Rozdzielczość to zdolność systemu obrazowania do odtworzenia szczegółów obiektu i zależy od takich czynników, jak rodzaj używanego oświetlenia, wielkość piksela czujnika i możliwości optyki. Im mniejsza szczegółowość obiektu, tym wyższa wymagana rozdzielczość obiektywu.

Wprowadzenie do procesu rozwiązywania problemów

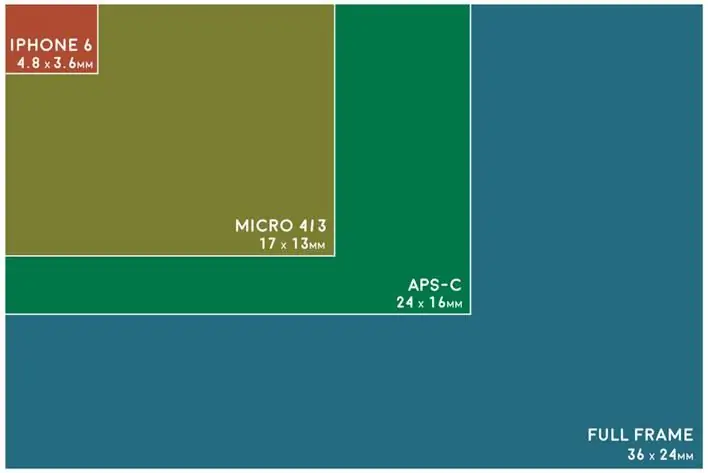

Jakość obrazu z kamery zależy od czujnika. Mówiąc najprościej, cyfrowy czujnik obrazu to chip wewnątrz korpusu aparatu, zawierający miliony światłoczułych punktów. Rozmiar czujnika aparatu określa, ile światła można wykorzystać do stworzenia obrazu. Im większy czujnik, tym lepsza jakość obrazu w miarę gromadzenia większej ilości informacji. Zazwyczaj aparaty cyfrowe reklamują się na rynku dla rozmiarów matrycy 16 mm, Super 35 mm, a czasem nawet do 65 mm.

Wraz ze wzrostem rozmiaru czujnika głębia ostrości będzie się zmniejszać przy danej aperturze, ponieważ większy odpowiednik wymaga zbliżenia się doobiektu lub użyj dłuższej ogniskowej, aby wypełnić kadr. Aby zachować tę samą głębię ostrości, fotograf musi używać mniejszych przysłon.

Ta płytka głębia ostrości może być pożądana, zwłaszcza w celu uzyskania rozmytego tła w przypadku portretów, ale fotografia krajobrazowa wymaga większej głębi, co jest łatwiejsze do uchwycenia dzięki elastycznemu rozmiarowi przysłony aparatów kompaktowych.

Podzielenie liczby pikseli poziomych lub pionowych na czujniku wskaże, ile miejsca zajmuje każdy z nich na obiekcie, i może służyć do oceny zdolności rozdzielczej obiektywu i rozwiązania obaw klientów dotyczących rozmiaru piksela obrazu cyfrowego urządzenia. Na początek ważne jest, aby zrozumieć, co może w rzeczywistości ograniczać rozdzielczość systemu.

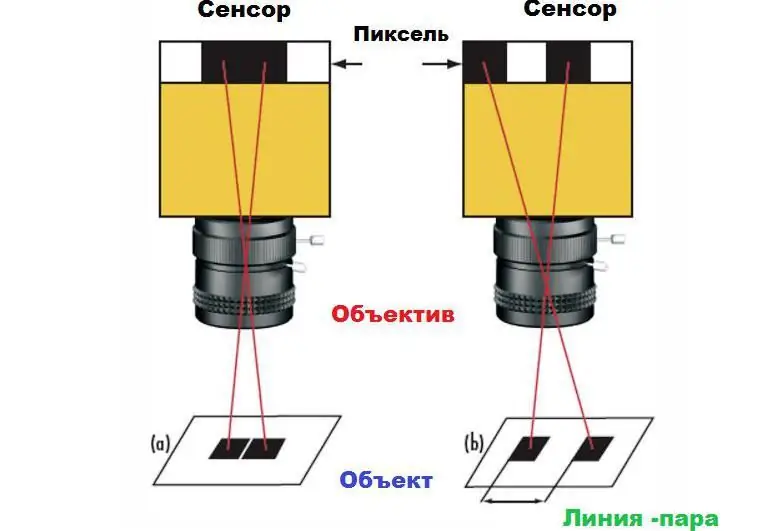

To stwierdzenie można zademonstrować na przykładzie pary kwadratów na białym tle. Jeśli kwadraty na czujniku aparatu zostaną zmapowane na sąsiednie piksele, na obrazie pojawią się jako jeden duży prostokąt (1a), a nie dwa oddzielne kwadraty (1b). Aby odróżnić kwadraty, wymagana jest między nimi pewna przestrzeń, co najmniej jeden piksel. Ta minimalna odległość to maksymalna rozdzielczość systemu. Limit bezwzględny jest określony przez rozmiar pikseli na czujniku, a także ich liczbę.

Cechy soczewki pomiarowej

Zależność między naprzemiennymi czarnymi i białymi kwadratami jest opisana jako para liniowa. Zazwyczaj rozdzielczość zależy od częstotliwości,mierzone w parach linii na milimetr - lp/mm. Niestety rozdzielczość obiektywu w cm nie jest liczbą bezwzględną. Przy danej rozdzielczości możliwość zobaczenia dwóch kwadratów jako oddzielnych obiektów będzie zależeć od poziomu skali szarości. Im większa separacja skali szarości między nimi a przestrzenią, tym bardziej stabilna jest możliwość rozwiązania tych kwadratów. Ten podział skali szarości jest znany jako kontrast częstotliwości.

Częstotliwość przestrzenna podawana jest w lp/mm. Z tego powodu obliczanie rozdzielczości w lp/mm jest niezwykle przydatne podczas porównywania obiektywów i określania najlepszego wyboru dla danych sensorów i aplikacji. Pierwsza to miejsce, w którym rozpoczyna się obliczanie rozdzielczości systemu. Rozpoczynając od czujnika, łatwiej jest określić, jakie parametry obiektywu są potrzebne do spełnienia wymagań urządzenia lub innych zastosowań. Najwyższa częstotliwość dozwolona przez czujnik Nyquist to w rzeczywistości dwa piksele lub jedna para linii.

Definicja rozdzielczości obiektywu, zwana także rozdzielczością przestrzeni obrazu systemowego, może być określona przez pomnożenie rozmiaru w Μm przez 2 w celu utworzenia pary i podzielenie przez 1000 w celu przeliczenia na mm:

lp/mm=1000/ (2 x piksel)

Czujniki z większymi pikselami będą miały niższe limity rozdzielczości. Czujniki z mniejszymi pikselami będą działać lepiej zgodnie z powyższym wzorem na rozdzielczość obiektywu.

Aktywny obszar czujnika

Możesz obliczyć maksymalną rozdzielczość dla obiektu, który ma byćoglądanie. W tym celu konieczne jest rozróżnienie wskaźników takich jak stosunek wielkości sensora, pola widzenia oraz liczby pikseli na sensorze. Rozmiar tego ostatniego odnosi się do parametrów aktywnego obszaru czujnika kamery, zwykle określanych przez rozmiar jego formatu.

Jednak dokładne proporcje będą się różnić w zależności od proporcji, a nominalne rozmiary matrycy powinny być używane tylko jako wskazówka, szczególnie w przypadku obiektywów telecentrycznych i dużych powiększenia. Rozmiar czujnika można obliczyć bezpośrednio z rozmiaru piksela i aktywnej liczby pikseli w celu wykonania testu rozdzielczości obiektywu.

Tabela pokazuje limit Nyquista związany z rozmiarami pikseli w niektórych bardzo powszechnie używanych czujnikach.

| Rozmiar piksela (µm) | Sprzęgnięty limit Nyquista (lp / mm) |

| 1, 67 | 299, 4 |

| 2, 2 | 227, 3 |

| 3, 45 | 144, 9 |

| 4, 54 | 110, 1 |

| 5, 5 | 90, 9 |

W miarę zmniejszania się rozmiaru pikseli powiązany limit Nyquista w lp/mm wzrasta proporcjonalnie. Aby określić absolutne minimum rozdzielczej plamki, którą można zobaczyć na obiekcie, należy obliczyć stosunek pola widzenia do rozmiaru czujnika. Nazywa się to również augmentacją podstawową.(PMAG).

Relacja powiązana z systemem PMAG pozwala na skalowanie rozdzielczości przestrzeni obrazu. Zazwyczaj podczas projektowania aplikacji nie podaje się jej w lp/mm, ale raczej w mikronach (µm) lub ułamkach cala. Możesz szybko przejść do ostatecznej rozdzielczości obiektu, korzystając z powyższego wzoru, aby ułatwić wybór rozdzielczości obiektywu z. Należy również pamiętać, że istnieje wiele dodatkowych czynników, a powyższe ograniczenie jest znacznie mniej podatne na błędy niż złożoność uwzględniania wielu czynników i obliczania ich za pomocą równań.

Oblicz ogniskową

Rozdzielczość obrazu to liczba pikseli w nim zawartych. Oznaczony w dwóch wymiarach, na przykład 640X480. Obliczenia można wykonać osobno dla każdego wymiaru, ale dla uproszczenia często sprowadza się to do jednego. Aby dokonać dokładnych pomiarów na obrazie, musisz użyć co najmniej dwóch pikseli na każdy najmniejszy obszar, który chcesz wykryć. Rozmiar czujnika odnosi się do wskaźnika fizycznego i z reguły nie jest wskazany w danych paszportowych. Najlepszym sposobem określenia rozmiaru matrycy jest przyjrzenie się jej parametrom w pikselach i pomnożenie ich przez współczynnik proporcji, w którym to przypadku zdolność rozdzielcza obiektywu rozwiązuje problemy związane ze złym ujęciem.

Na przykład kamera Basler acA1300-30um ma rozmiar piksela 3,75 x 3,75um i rozdzielczość 1296 x 966 pikseli. Rozmiar czujnika to 3,75 µm x 1296 na 3,75 µm x 966=4,86 x 3,62 mm.

Format czujnika odnosi się do rozmiaru fizycznego i nie zależy od rozmiaru w pikselach. To ustawienie jest używane dookreślić, z którym obiektywem aparat jest zgodny. Aby były zgodne, format obiektywu musi być większy lub równy rozmiarowi matrycy. Jeśli używany jest obiektyw o mniejszym współczynniku proporcji, obraz będzie winietować. Powoduje to, że obszary czujnika poza krawędzią formatu obiektywu stają się ciemne.

Piksele i wybór kamery

Aby zobaczyć obiekty na obrazie, musi być między nimi wystarczająca przestrzeń, aby nie łączyły się z sąsiednimi pikselami, w przeciwnym razie będą nie do odróżnienia. Jeśli obiekty mają po jednym pikselu, separacja między nimi również musi wynosić co najmniej jeden element, to dzięki temu powstaje para linii, która faktycznie ma rozmiar dwóch pikseli. To jeden z powodów, dla których niepoprawne jest mierzenie rozdzielczości aparatów i obiektywów w megapikselach.

W rzeczywistości łatwiej jest opisać możliwości rozdzielczości systemu w kategoriach częstotliwości par linii. Wynika z tego, że wraz ze zmniejszaniem się rozmiaru piksela wzrasta rozdzielczość, ponieważ można umieszczać mniejsze obiekty na mniejszych elementach cyfrowych, mieć mniej miejsca między nimi i nadal określać odległość między fotografowanymi obiektami.

Jest to uproszczony model wykrywania obiektów przez czujnik kamery bez uwzględniania szumu lub innych parametrów, co stanowi idealną sytuację.

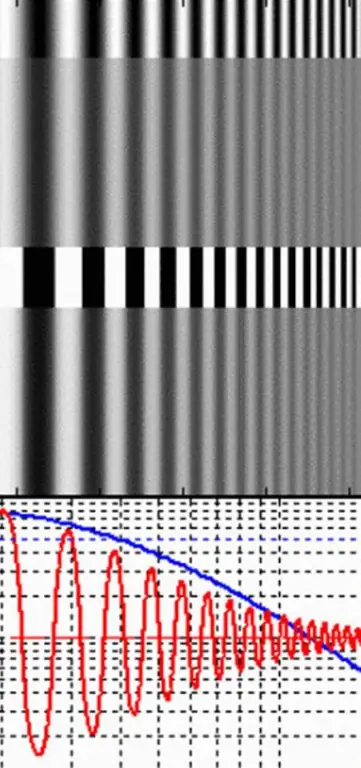

Wykresy kontrastu MTF

Większość obiektywów nie jest idealnymi systemami optycznymi. Światło przechodzące przez soczewkę ulega pewnej degradacji. Pytanie brzmi, jak to ocenićdegradacja? Przed udzieleniem odpowiedzi na to pytanie konieczne jest zdefiniowanie pojęcia „modulacji”. Ta ostatnia jest miarą kontrastu przy danej częstotliwości. Można by spróbować przeanalizować obrazy świata rzeczywistego wykonane przez obiektyw, aby określić modulację lub kontrast dla detali o różnych rozmiarach lub częstotliwościach (rozstaw), ale jest to bardzo niepraktyczne.

Zamiast tego znacznie łatwiej jest zmierzyć modulację lub kontrast dla par naprzemiennie białych i ciemnych linii. Nazywa się je kratą prostokątną. Odstęp linii w prostokątnej siatce falowej to częstotliwość (v), dla której mierzy się funkcję modulacji lub kontrastu soczewki oraz rozdzielczość w cm.

Maksymalna ilość światła będzie pochodzić z jasnych pasm, a minimalna z ciemnych pasm. Jeśli światło jest mierzone jako jasność (L), modulację można określić według następującego równania:

modulacja=(Lmax - Lmin) / (Lmax + Lmin), gdzie: Lmax to maksymalna jasność białych linii w siatce, a Lmin to minimalna jasność ciemnych.

Gdy modulacja jest definiowana w kategoriach światła, często nazywa się ją kontrastem Michelsona, ponieważ do pomiaru kontrastu wykorzystuje się stosunek luminancji z jasnych i ciemnych pasm.

Na przykład, istnieje siatka prostokątna o określonej częstotliwości (v) i modulacji oraz nieodłączny kontrast między ciemnymi i jasnymi obszarami odbitymi od tej siatki przez soczewkę. Modulacja obrazu, a tym samym kontrast obiektywu, jest mierzony dla danej częstotliwościsłupki (v).

Funkcja przenoszenia modulacji (MTF) jest zdefiniowana jako modulacja M i obrazu podzielona przez modulację bodźca (obiektu) M o, jak pokazano w poniższym równaniu.

|

MTF (v)=M i / M 0 |

Siatki testowe USF są drukowane na 98% jasnym papierze laserowym. Czarny toner do drukarek laserowych ma współczynnik odbicia około 10%. Zatem wartość dla M 0 wynosi 88%. Ale ponieważ film ma bardziej ograniczony zakres dynamiki w porównaniu z ludzkim okiem, można bezpiecznie założyć, że M 0 wynosi zasadniczo 100% lub 1. Zatem powyższy wzór sprowadza się do następującego więcej proste równanie:

|

MTF (v)=Mi |

Więc len MTF dla danej częstotliwości siatki (v) jest po prostu zmierzoną modulacją siatki (Mi) podczas fotografowania przez obiektyw na kliszy.

Rozdzielczość mikroskopu

Rozdzielczość obiektywu mikroskopu to najkrótsza odległość między dwoma różnymi punktami w polu widzenia okularu, które nadal można rozróżnić jako różne obiekty.

Jeśli dwa punkty są bliżej siebie niż twoja rozdzielczość, będą wyglądać na niewyraźne, a ich pozycje będą niedokładne. Mikroskop może oferować duże powiększenie, ale jeśli soczewki są słabej jakości, wynikająca z tego słaba rozdzielczość pogorszy jakość obrazu.

Poniżej znajduje się równanie Abbego, gdzie rozdzielczośćmoc obiektywu mikroskopu z jest mocą rozdzielczą równą długości fali użytego światła podzielonej przez 2 (apertura numeryczna obiektywu).

Kilka elementów wpływa na rozdzielczość mikroskopu. Mikroskop optyczny ustawiony przy dużym powiększeniu może dawać obraz, który jest rozmazany, ale nadal ma maksymalną rozdzielczość obiektywu.

Cyfrowa przysłona obiektywu wpływa na rozdzielczość. Rozdzielczość obiektywu mikroskopu to liczba, która wskazuje zdolność soczewki do zbierania światła i rozdzielenia punktu w ustalonej odległości od obiektywu. Najmniejszy punkt, który może rozdzielić soczewka, jest proporcjonalny do długości fali zebranego światła podzielonej przez liczbową liczbę apertury. Dlatego większa liczba odpowiada większej zdolności obiektywu do wykrywania doskonałego punktu w polu widzenia. Apertura numeryczna obiektywu zależy również od stopnia korekcji aberracji optycznej.

Rozdzielczość soczewki teleskopu

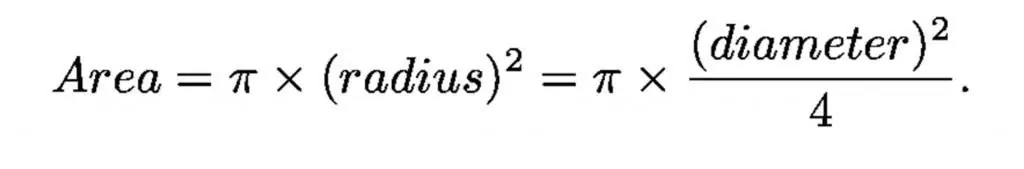

Jak lejek świetlny, teleskop jest w stanie zbierać światło proporcjonalnie do powierzchni otworu, ta właściwość jest główną soczewką.

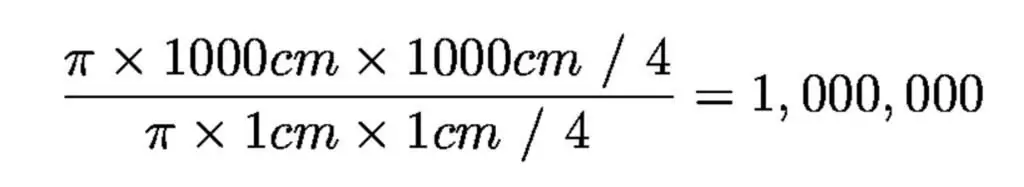

Średnica źrenicy przystosowanej do ciemności ludzkiego oka wynosi nieco poniżej 1 centymetra, a średnica największego teleskopu optycznego wynosi 1000 centymetrów (10 metrów), więc największy teleskop jest milion razy większy w kolekcji obszar niż ludzkie oko.

Dlatego teleskopy widzą słabsze obiekty niż ludzie. I mieć urządzenia, które gromadzą światło za pomocą elektronicznych czujników przez wiele godzin.

Istnieją dwa główne typy teleskopów: refraktory soczewkowe i reflektory lustrzane. Duże teleskopy to reflektory, ponieważ lustra nie muszą być przezroczyste. Lustra teleskopowe należą do najbardziej precyzyjnych konstrukcji. Dozwolony błąd na powierzchni to około 1/1000 szerokości ludzkiego włosa - przez otwór o długości 10 metrów.

Lustra były kiedyś robione z ogromnych, grubych płyt szklanych, aby nie opadały. Dzisiejsze lustra są cienkie i elastyczne, ale są sterowane komputerowo lub w inny sposób podzielone na segmenty i wyrównane za pomocą sterowania komputerowego. Oprócz zadania polegającego na znalezieniu słabych obiektów, celem astronoma jest również zobaczenie ich drobnych szczegółów. Stopień, w jakim można rozpoznać szczegóły, nazywa się rozdzielczością:

- Rozmyte obrazy=słaba rozdzielczość.

- Wyraźne obrazy=dobra rozdzielczość.

Ze względu na falową naturę światła i zjawiska zwane dyfrakcją, średnica lustra lub soczewki teleskopu ogranicza jego ostateczną rozdzielczość w stosunku do średnicy teleskopu. Rozdzielczość oznacza tutaj najmniejszy szczegół kątowy, który można rozpoznać. Małe wartości odpowiadają doskonałej szczegółowości obrazu.

Teleskopy radiowe muszą być bardzo duże, aby zapewnić dobrą rozdzielczość. Atmosfera Ziemi jestburzliwy i rozmyty obraz teleskopu. Astronomowie ziemscy rzadko potrafią osiągnąć maksymalną rozdzielczość aparatu. Turbulentny wpływ atmosfery na gwiazdę nazywa się widzeniem. Ta turbulencja powoduje, że gwiazdy „mrugają”. Aby uniknąć tych rozmyć atmosferycznych, astronomowie wystrzeliwują teleskopy w kosmos lub umieszczają je w wysokich górach o stabilnych warunkach atmosferycznych.

Przykłady obliczania parametrów

Dane do określenia rozdzielczości obiektywu Canon:

- Rozmiar piksela=3,45 µm x 3,45 µm.

- Piksele (poziom x pion)=2448 x 2050.

- Pożądane pole widzenia (w poziomie)=100 mm.

- Limit rozdzielczości czujnika: 1000/2x3, 45=145 lp/mm.

- Wymiary czujnika:3,45x2448/1000=8,45 mm3, 45x2050/1000=7,07 mm.

- PMAG:8, 45/100=0,0845 mm.

- Rozdzielczość obiektywu pomiarowego: 145 x 0,0845=12,25 lp/mm.

W rzeczywistości te obliczenia są dość złożone, ale pomogą Ci stworzyć obraz w oparciu o rozmiar czujnika, format pikseli, odległość roboczą i pole widzenia w mm. Obliczenie tych wartości pozwoli określić najlepszy obiektyw dla Twoich zdjęć i aplikacji.

Problemy współczesnej optyki

Niestety podwojenie rozmiaru matrycy stwarza dodatkowe problemy dla obiektywów. Jednym z głównych parametrów wpływających na koszt obiektywu obrazu jest format. Zaprojektowanie obiektywu do matrycy o większym formacie wymagaliczne pojedyncze elementy optyczne, które powinny być większe, a przenoszenie systemu sztywniejsze.

Obiektyw zaprojektowany dla czujnika 1" może kosztować pięć razy więcej niż obiektyw zaprojektowany dla czujnika ½", nawet jeśli nie może korzystać z tych samych specyfikacji przy ograniczonej rozdzielczości w pikselach. do określenia zdolności rozdzielczej obiektywu.

Obrazowanie optyczne staje dziś przed większymi wyzwaniami niż dziesięć lat temu. Czujniki, z którymi są używane, mają znacznie wyższe wymagania dotyczące rozdzielczości, a rozmiary formatu są jednocześnie mniejsze i większe, podczas gdy rozmiar piksela nadal się zmniejsza.

W przeszłości optyka nigdy nie ograniczała systemu obrazowania, dziś już tak. Tam, gdzie typowy rozmiar piksela wynosi około 9 µm, znacznie powszechniejszy rozmiar to około 3 µm. Ten 81-krotny wzrost gęstości punktów odbił się na optyce i chociaż większość urządzeń jest dobra, wybór obiektywu jest teraz ważniejszy niż kiedykolwiek.